Hoy Hablamos Sobre

¿Quién protege a los niños frente a la IA generativa?

el impacto de la IA generativa en niños

¿Quién protege a los niños frente a la IA generativa?

La inteligencia artificial generativa ha irrumpido en nuestras vidas con una velocidad sorprendente. En cuestión de meses, herramientas como ChatGPT, Claude, Gemini pasaron de ser desconocidas para la mayoría de las personas a integrarse en espacios educativos, familiares, creativos y laborales. Esta transformación ha abierto oportunidades, pero también ha generado preguntas difíciles, especialmente cuando se trata de un grupo particularmente vulnerable: los niños.

¿Estamos tomando en cuenta cómo impacta esta tecnología en la infancia? ¿Entendemos sus riesgos reales y sus potenciales beneficios? ¿Quién vela por los derechos, la seguridad y el bienestar emocional de los niños cuando interactúan con la IA?

Estas preguntas motivaron una profunda investigación liderada por el Alan Turing Institute y la Fundación LEGO, cuyo informe conjunto titulado “Understanding the Impacts of Generative AI Use on Children” ofrece una de las miradas más completas y urgentes sobre el tema. Basado en encuestas, talleres participativos y análisis cualitativos, este estudio nos presenta un retrato multifacético del vínculo entre infancia e inteligencia artificial generativa.

1- El contexto: IA generativa y acceso infantil

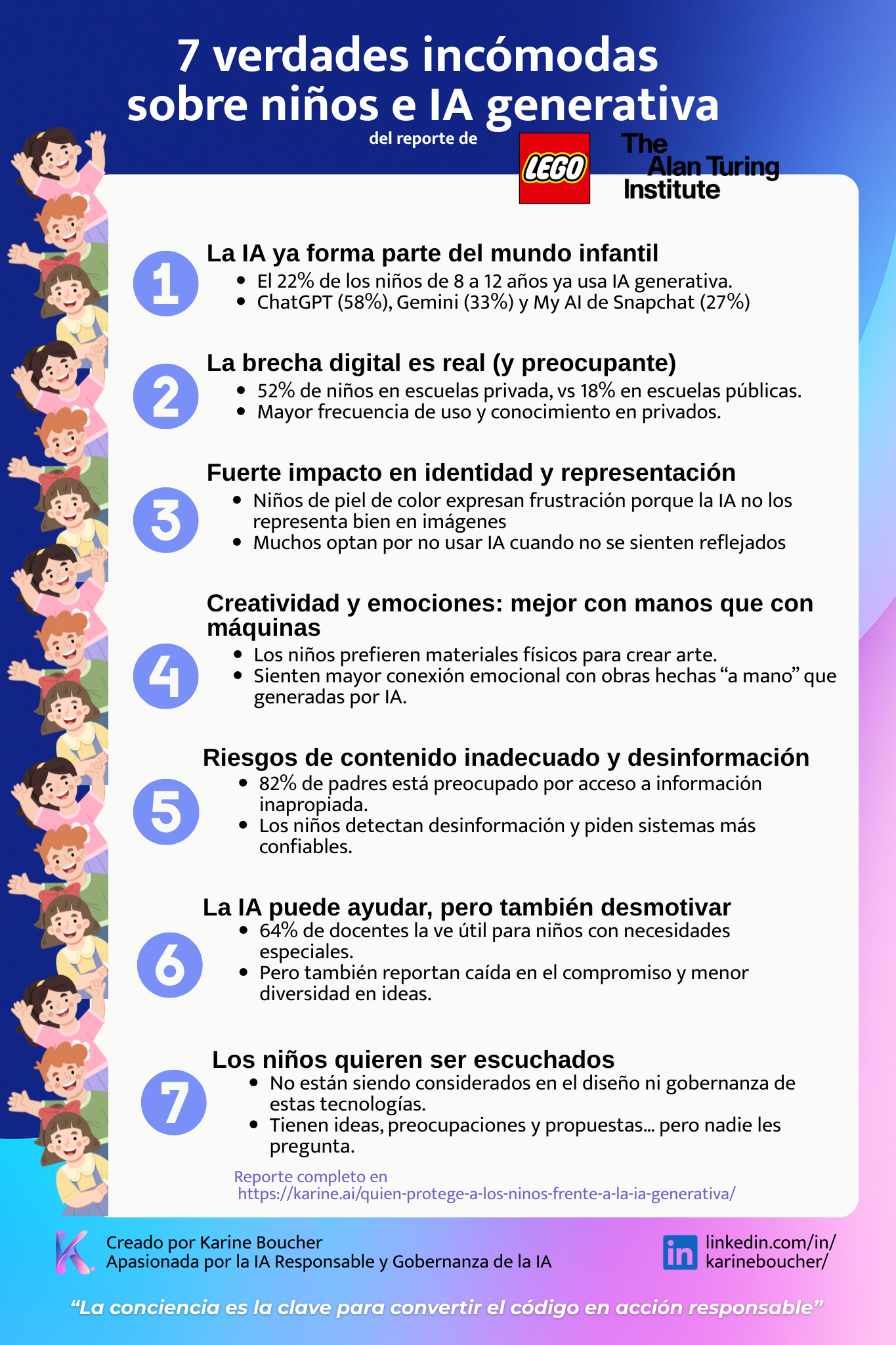

Según el estudio, al menos un 22% de los niños entre 8 y 12 años en Reino Unido ya ha utilizado herramientas de IA generativa. En la mayoría de los casos, lo hacen sin acompañamiento adulto, sin comprender del todo cómo funcionan y, mucho menos, sin herramientas para evaluar críticamente los contenidos que reciben.

Los usos más comunes incluyen:

- Crear imágenes divertidas o arte digital.

- Resolver tareas escolares.

- Buscar información o consejos personales.

- Jugar, entretenerse o sentirse acompañados.

Los niños con necesidades educativas especiales reportaron un uso aún más intensivo de la IA generativa, señalando que les ayuda a expresar pensamientos que no logran comunicar fácilmente por otros medios.

2- Brecha digital: entre lo privado y lo público

Uno de los hallazgos más alarmantes del estudio es la gran diferencia en el uso de la IA entre niños de escuelas privadas y públicas. El 52% de los estudiantes de escuelas privadas reportó haber utilizado IA generativa, frente a apenas el 18% en escuelas públicas. Además, los docentes de escuelas privadas indicaron estar más familiarizados con estas tecnologías, lo que sugiere que la brecha digital no solo persiste, sino que se amplía.

3- Representación, sesgo y frustración

El informe documenta cómo muchos niños racializados se sintieron frustrados cuando las herramientas de generación de imágenes no los representaban correctamente. Algunos niños tuvieron que ajustar sus prompts varias veces hasta obtener un resultado en el que se sintieran reflejados. Otros simplemente dejaron de usar la herramienta.

Este hallazgo pone de relieve un problema estructural: cuando la IA falla en representar de forma justa a todos los usuarios, refuerza desigualdades existentes y desincentiva su uso por parte de grupos históricamente marginados.

4- Creatividad y emociones: ¿una IA que conecta o aísla?

La investigación revela que, si bien algunos niños encontraron nuevas formas de expresión creativa a través de la IA, la mayoría aún prefiere el arte manual. Las emociones, el orgullo y la conexión personal con lo creado parecen ser más intensos cuando se trabaja con materiales físicos. Además, los procesos creativos con IA fueron descritos como más solitarios, mientras que el arte tradicional fomentó la interacción y el juego colaborativo.

5- Riesgos: contenido inadecuado y pensamiento crítico

Un dato particularmente preocupante: el 82% de los padres se mostró inquieto por el acceso de sus hijos a contenido inexacto o inapropiado mediante estas herramientas. Sin embargo, solo el 50% expresó preocupación por el posible uso de IA para hacer trampa en la escuela. Esta diferencia refleja un desconocimiento generalizado de cómo la IA está siendo utilizada por los niños.

Los docentes también manifestaron preocupación. El 72% teme que el uso excesivo de estas tecnologías perjudique el pensamiento crítico de sus alumnos, fomentando una aceptación pasiva de lo que la IA dice.

6- El rol de los docentes: uso productivo vs. dudas pedagógicas

Curiosamente, el 85% de los docentes que usan IA generativa afirman que ha mejorado su productividad. Muchos la emplean para preparar clases, generar materiales o investigar. Sin embargo, la percepción cambia cuando se trata del uso por parte de los alumnos. Casi la mitad de los profesores considera que ha disminuido el compromiso en clase y la diversidad de ideas.

7- ¿Y qué dicen los niños?

Los talleres realizados en escuelas públicas revelaron ideas potentes. Los niños se mostraron preocupados por los impactos ambientales de la IA, por su sesgo y por la posibilidad de desinformación. Pero también vieron oportunidades: quisieran que la IA sirviera para ayudar a otros niños con dificultades, apoyar el aprendizaje personalizado o acompañarlos cuando se sienten solos.

Un mensaje claro: los niños quieren participar, ser escuchados, opinar. Desean que estas tecnologías sean más seguras, inclusivas y representativas.

Recomendaciones clave del informe

- Desarrollar IA generativa apropiada para la edad infantil, con filtros de seguridad integrados.

- Fomentar la alfabetización digital en IA desde edades tempranas, tanto en escuelas como en familias.

- Crear certificaciones que identifiquen herramientas seguras para entornos escolares.

- Incluir a niños en el diseño y evaluación de tecnologías que los afectan directamente.

- Reducir la brecha de acceso entre escuelas públicas y privadas.

- Abordar el sesgo de representación y asegurar diversidad en los modelos generativos.

- Ofrecer herramientas y materiales offline como complemento creativo.

- Proporcionar formación especializada a docentes para un uso ético y pedagógico de la IA.

Reflexión final

Este informe no es solo una advertencia. Es también una invitación. A escuchar más a los niños, a incluirlos en las decisiones sobre la tecnología que ya los rodea, a diseñar con ellos, para ellos.

La IA generativa tiene un potencial enorme, pero solo si la desarrollamos con cuidado, respeto y responsabilidad. Y eso implica pensar en los más pequeños, no como futuros usuarios, sino como protagonistas del presente digital.

Porque proteger a los niños frente a la IA generativa no es una tarea opcional. Es un acto de justicia.

Fuente: Alan Turing Institute y LEGO Group. Traducción y análisis por Karine Boucher – karine.ai

Te adjunto el reporte completo del Grupo Lego y Alan Turing Institute traducido al español.

Si quieres el texto original en inglés, lo puedes encontrar directamente en la página web del ATI.

Quieres aprender más sobre la IA Responsable y Gobernanza de la IA, mira los artículos de blog que he redactado para ti.

Para cualquier duda que puedas tener, me puedes mandarme email a info@karine.ai, con mucho gusto te contestaré.