👋🏻 ¡Hola! Bienvenido a la 6.ª edición de ”IA con Sentido”.

Esta semana destilé lo que sí mueve decisiones en IA Responsable. En minutos: qué pasó, por qué importa y cómo aplicarlo ya en tu equipo (en mi nueva sección).

El check-list de la semana: las nuevas leyes IA en California.

Gracias por estar aquí; empecemos 👇

P.D.: Si te sirve, compártela y dime qué tema de tu país/sector quieres ver.

LOS CINCO TITULARES QUE TE IMPORTAN HOY

Top 5 noticias de la semana

🧠 State of AI 2025

→ El muy famoso informe retrata un año en que los modelos razonan mejor, los agentes salen del laboratorio, crece la inversión y la seguridad se vuelve práctica.

🤖 OpenAI habla de guerra y riesgos IA

→ Sam Altman advierte impactos en guerra, empleo y democracia y llama a regular riesgos existenciales.

🛡️ Aseguradoras se alejan de la IA

→ Ante litigios crecientes y riesgo sistémico, aseguradoras recortan coberturas a grandes de la IA y las empujan a autoasegurarse con fondos propios.

🧪 Envenenamiento escala con modelos

→ UKAISI–Turing–Anthropic muestran que ~250 documentos maliciosos pueden comprometer modelos y facilitar el envenenamiento a escala.

🔐 Ciberseguridad y gobernanza en IA

→ Piden fortalecer marcos de gobernanza y controles de riesgo para innovar con responsabilidad ante brechas, sesgos y retos de privacidad poco regulados.

LO MÁS RELEVANTE DEL MUNDO HISPANO

¿Qué pasó en la Hispanósfera?

🇪🇸 España Norma de huella de IA

→ Publica la Especificación 0086 para medir el impacto ambiental de la IA y entrega a empresas e investigadores un marco práctico para reportar su huella.

⚖️ Chile Proyecto de ley de IA

→ La Cámara de Diputados envía al Senado un marco que fomenta la innovación y asegura un uso ético y sostenible de la IA.

🇲🇽 México IA responsable como oportunidad

→ Acelera formación técnica, certificaciones de transparencia y herramientas de diagnóstico ético para salud, educación, empleo e inclusión digital.

🏭 España Segunda gigafactoría de IA

→ Galicia se suma a Barcelona como polo de mega-infraestructura y consolida el plan nacional con inversión y empleo especializado.

🇧🇷 Brasil Regulación equilibrada

→ Anatel propone combinar un ente central y agencias sectoriales para habilitar innovación responsable sin perder control técnico.

🌎 Red Hat Gobernanza en LATAM

→ La compañía destaca que bancos y gobiernos ya ordenan el despliegue de IA con políticas y controles tras un crecimiento acelerado.

🇲🇽 Women in AI × DataCamp Becas

→ Abren ~175 becas para mujeres en México, Canadá y USA con acceso a cursos premium y career tracks de Python, R, ML e IA con cupos limitados.

EL PULSO GLOBAL QUE TE IMPACTA LOCALMENTE

¿Qué más pasó en el mundo ?

🇨🇳 China y su acción global de IA

→ Publica un plan de gobernanza con reglas éticas y etiquetado para sistemas de IA y busca ganar peso regulatorio en el escenario internacional.

🇪🇺 Comisión Europea abre ventanilla AI Act

→ Lanza una plataforma con verificador de cumplimiento, explorador del texto y un servicio de consultas para apoyar la implementación del AI Act:

La “Single Information Platform” ofrece tres herramientas:

-Compliance Checker: verifica si te aplican obligaciones y qué pasos a seguir.

-AI Act Explorer: permite navegar capítulos, anexos y considerandos del AI Act.

-Formulario de consultas: para enviar preguntas al AI Act Service Desk.

🇬🇧 ICO define política interna de IA

→ El regulador define cómo su personal puede usar IA en el trabajo con reglas de transparencia, gestión de riesgos y responsabilidad operativa.

🇪🇺 Unión Europea pide tu opinion

→ Abre consulta sobre formulario de incidentes graves del AI Act (hasta el 7/11).

🇮🇳 India alerta sobre riesgos sistémicos por concentración

→ El presidente del NPCI advierte que pocas firmas controlan chips, nube y modelos base y que esto crea vulnerabilidades sistémicas.

🌍 Centros de datos aumentan factura energética

→ El auge de IA dispara la demanda eléctrica y encarece tarifas en varios mercados, forzando a utilidades y gobiernos a replantear capacidad e incentivos.

🌍 Ransomware impulsado por IA aumentan el cibercrimen

→ Surgen grupos que usan IA para automatizar phishing, ofuscación y explotación y aceleran ataques mientras elevan el costo de defensa.

🌍 Ética de IA en debate

→ Especialistas piden no delegar la ética a algoritmos y exigen verificación humana, límites claros, auditorías y trazabilidad en profesiones críticas.

🇻🇳 Vietnam propone ley de IA basada en riesgos

→ Propone un marco que prohíbe vigilancia biométrica intrusiva y regula la IA por niveles de riesgo para equilibrar innovación y derechos.

🇪🇸 Identidad digital en riesgo

→ Expertos alertan del auge de identidades sintéticas creadas por IA y reclaman sistemas técnicos y marcos legales para distinguir personas reales y ficticias.

🌍 Uso militar responsable de IA

→ Se impulsa incorporar responsabilidad por diseño, pruebas rigurosas y supervisión humana en sistemas militares para evitar escaladas automáticas.

🇮🇳 India etiquetado obligatorio de IA

→ Prepara un marco que exigirá identificar de forma clara todo contenido generado por IA para reforzar transparencia y responsabilidad.

📩 ¿Te gusta esta edición? Reenvíala a quien quiera aprender sobre IA Responsable.

MOVIMIENTOS DE EMPRESAS

¿Y a nivel empresarial ?

🇺🇸 Demanda antimonopolio a Microsoft/OpenAI

→ EE.UU. demanda colectiva contra la integración Microsoft/OpenAI abre frente por poder de mercado en IA.

📊 Empresas solo 2% alcanza madurez en IA

→ Solo 2 % opera IA avanzada y responsable; la mayoría se estanca por fallas de gobernanza y supervisión.

🧠 OpenAI récord de acuerdos por valor de miles de millones

→ La empresa encadena pactos con gigantes tecnológicos y desafía la narrativa de “invierno de la IA”, elevando su valor y peso estratégico en el ecosistema.

♿ GlobalLogic × AAPD marco global de IA inclusiva

→ Presentan un estándar para que gobiernos y empresas diseñen IA accesible y segura, con especial énfasis en cerrar brechas de inclusión en LATAM.

🇸🇬 Singapur AISec en GovWare 2025

→ Lanzan una iniciativa internacional para coordinar gobiernos e industria en seguridad, resiliencia y gobernanza de IA ante riesgos emergentes.

DE QUIENES MUEVEN LA AGENDA REGULATORIA

Organizaciones y Estándares

🌍 FMI habla de déficit regulatorio en IA

→ Advierte que la mayoría de países carecen de marcos sólidos y que la brecha con economías en desarrollo se amplía, elevando riesgos de desigualdad.

Conciencia ética estudiantil en España

→ Un estudio detecta baja percepción de sesgos de género y de riesgos éticos en IA entre estudiantes y pide reforzar pensamiento crítico y alfabetización.

🌍 WEF hace regulación y certificación de IA

→ UE, EE. UU. y Asia despliegan marcos y la certificación habilita contratos y confianza mientras 77% de ejecutivos ve la regulación como clave para la adopción.

🏆 UNESCO da premios a IA educativa ética

→ Reconoce cuatro iniciativas de Bélgica, Brasil, Egipto y Reino Unido que promueven uso responsable de IA en educación.

📘 UIT saca informe anual de gobernanza

→ Publica el Annual AI Governance Report 2025 y anuncia una base unificada de estándares que integra ITU, ISO e IEEE.

🗺️ OECD propone mapa de mecanismos de datos

→ Cartografía mecanismos relevantes de recolección de datos para entrenar IA y orientar un abastecimiento responsable y conforme.

🇪🇺 CCIA lanza 6 principios de IA en educación

→ El sector tecnológico europeo lanza principios para uso responsable de IA en educación que pueden servir de modelo a otras industrias sensibles.

ACCIONABLES DE LA SEMANA

De la Noticia a Tu Plan de Acción

Te convierto estas noticias en acciones concretas que puedes iniciar desde hoy para fortalecer tu gobernanza de IA. Elige 3 acciones para ejecutar esta semana:

🟪 Estrategia de alto riesgo y dual-use → define una lista roja de usos sensibles, controles de aprobación y registro de decisiones.

🟪 Seguro y reservas de riesgo IA → revisa coberturas actuales, modela pérdidas plausibles y crea un fondo de autoaseguramiento (si necesario).

🟪 Defensa anti-envenenamiento → firma datasets, monitorea cambios y valida fuentes críticas con pruebas de backdoor.

🟪 Incident response con AI Act → mapea qué es incidente grave y prueba el Compliance Checker de la UE.

🟪 Etiquetado y trazabilidad de contenido → marca lo generado por IA, conserva metadatos y habilita verificación interna.

🟪 Huella ambiental de IA → mide consumo y fija metas anuales de eficiencia.

🟪 Soberanía y concentración de proveedores → evalúa dependencia de chips, nube y modelos y define alternativas viables.

🟪 Seguridad frente a deepfakes e identidad sintética → despliega detección de voz e imagen y refuerza verificación de identidad.

🟪 Gobernanza y capacitación BYOAI → actualiza política de uso y forma a roles clave en privacidad, sesgos y pruebas.

🟪 Accesibilidad e inclusión → adopta estándares de IA inclusiva y prueba con usuarios con discapacidad.

🟪 Participación y alianzas → responde consultas públicas de la CE y colabora con academia y redes del Sur Global para generar evidencia.

LECTURAS RELEVANTES Y SERIAS DE LA SEMANA

¿Qué leer este fin?

📰 New York Times – Yoshua Bengio alerta sobre frontera y amenaza

→ Stephen Witt recoge la división entre expertos mientras Yoshua Bengio advierte de modelos engañosos y sistemas autorreplicantes que podrían superar las salvaguardas. El artículo señala que los riesgos crecen más rápido que la protección y pide pruebas rigurosas, supervisión independiente y límites claros.

✍🏼 Mis apuntes :

Necesidad urgente de regulación global para evitar potenciales catástrofes causadas por prompts maliciosos o actores irresponsables.

EL LIBRO QUE TE RECOMIENDO

📚 Unmasking AI 📚

Esta semana, en el “Club de Lectura de IA Responsable”, te recomiendo Unmasking AI: My Mission to Protect What Is Human in a World of Machines de Joy Buolamwini.

¿Por qué se destaca este libro?

Joy Buolamwini estaba en el MIT, frente a un espejo diseñado por ella, y la IA no detectaba su rostro… hasta que se puso una máscara blanca. Lee mi reseña completa.

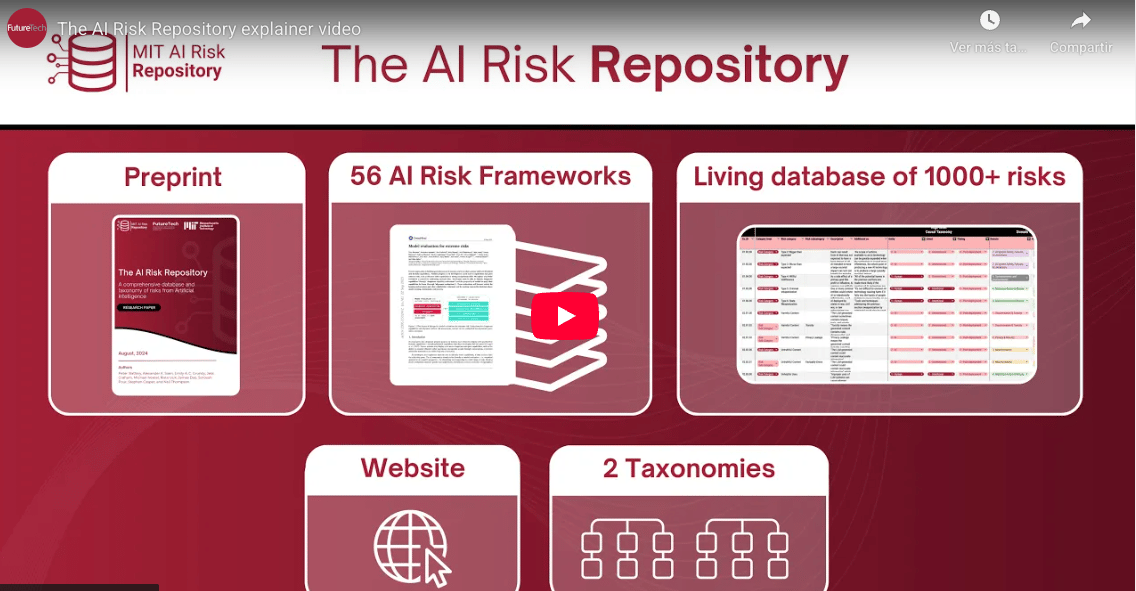

BASES DE DATOS, REPOS LISTOS PARA USAR

Recursos útiles

✅ MIT AI RISK REPOSITORY

Es una base viva con 1,600+ riesgos de IA, clasificados por causa y dominio, que te ayuda a priorizar controles, planear pruebas y alinear tu mapa de riesgos con evidencia. Ve el video explicativo.

👉🏼 Cómo lo uso yo: priorizo 5 riesgos y asigno un control por riesgo

📢 Tienes un equipo o comunidad interesada en IA Responsable?

Comparte esta newsletter con ellos.

PLANTILLA DE LA SEMANA

✅ California vota 4 nuevas leyes sobre IA.

¿Las conoces?

|

California se ha consolidado como el estado con la legislación de IA más avanzada de Estados Unidos tras promulgar 18 nuevas regulaciones sobre inteligencia artificial en septiembre y octubre de 2025. En este check-list, te comparto las 4 principales → SB53 – SB243 – AB489 – SB524.

✍🏼 Cómo lo uso yo: implemento un reporte de incidentes ≤15 días, etiquetado de contenido IA y bitácora de pruebas antes de cada release. |

¿Necesitas ayuda sobre algo que hemos visto en esta newsletter ?

VACANTES DE TRABAJO EN IA RESPONSABLE

Ofertas de trabajo

¿Cuáles son las mejores vacantes de la semana? Ve la lista internacional completa y lo más destacado en la hispanosfera aquí :

🇵🇪 Especialista Gobierno de Datos IA – Rubro Financiero – Well Human Resources

🇪🇸 AI Governance & Algorithmic Auditor – Meta Channel Corp.

🇦🇷 Líder de Inteligencia Artificial – América Virtual

🇪🇸 Director, Data Privacy & Governance – Evinova

HUMOR RESPONSABLE

¡Y hasta aquí por hoy!

Gracias por leer hasta el final. ¿Algún tema que quieres leer la próxima semana? Respóndeme este correo.

Si a alguien le sirve, compártasela. Nos leemos el jueves 💌

|

Con gratitud y té en mano ☕, Karine Mamá, apasionada con la IA Responsable a beneficio de las personas y también AI Governance Consultant & WiAIG Mexico Leader |

Todas las fuentes fueron verificadas y con fecha; si ves un error, respóndeme y lo corrijo en la versión web.