El tema de hoy

ChatGPT recuerda… pero puede olvidar?

Implicaciones de gobernanza en la nueva función de memoria ampliada

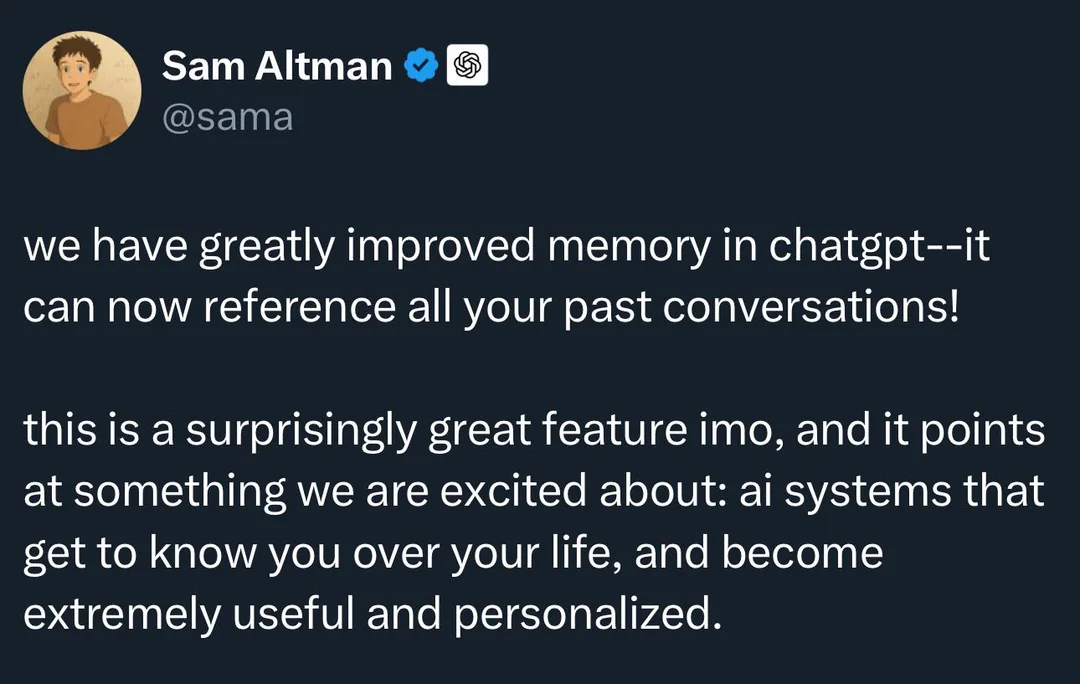

El 10 de abril de 2025, Sam Altman, CEO de OpenAI, anunció una actualización significativa en ChatGPT: ahora podrá hacer referencia a todas tus conversaciones anteriores, no solo a la actual. Esta función de memoria mejorada apunta a una experiencia más fluida, personalizada y continua para el usuario. Como bien dijo el CEO de OpenAI, esta evolución representa “sistemas de IA que te conocen a lo largo del tiempo y se vuelven extremadamente útiles”.

Qué cambia realmente?

Hasta ahora, la memoria en ChatGPT era discreta y explícita: solo recordaba lo que el usuario le pedía explícitamente (“recuérdame que soy alérgico a la lavanda”). Además, el usuario tenía visibilidad sobre qué recordaba la IA y podía gestionarlo.

La nueva actualización cambia esto profundamente:- ChatGPT podrá inferir y vincular información mencionada en distintas conversaciones.

- Esto ocurre aunque el usuario no haya activado conscientemente la memoria para ese dato.

- El modelo empieza a actuar con una memoria integrada y transversal, no limitada a sesiones o temas.

OpenAI ha aclarado que los usuarios podrán seguir desactivando esta función o utilizar “chats temporales” que no se guardan en la memoria. También han dividido la configuración en dos partes:

- “Saved memories”: con entradas visibles y opción de eliminación individual.

- “Chat history”: que permite a ChatGPT usar todas las conversaciones previas como contexto, pero sin mostrar qué está recordando ni dar opción a borrado granular.

Entonces, dónde está el problema?

Desde una perspectiva de gobernanza de la IA, esta funcionalidad plantea interrogantes fundamentales:

- Cuál es el límite entre personalización y perfilado?

- Qué significa el consentimiento informado cuando la memoria se infiere, no se activa explícitamente?

- El usuario puede realmente entender qué se recuerda y cómo se usa?

- El derecho al olvido puede ejercerse de forma efectiva? O simplemente se “oculta” lo recordado?

Sabemos, además, que muchos usuarios —a menudo sin saberlo— ingresan información sensible en sus interacciones con IA: nombres, correos, información de clientes, conversaciones emocionales, diagnósticos médicos, etc.

Y, aunque OpenAI afirma que no utiliza estas conversaciones para reentrenar modelos por defecto, el riesgo permanece.

Una alerta para el Sur Global

Esta actualización no está (por ahora) disponible en la Unión Europea, Reino Unido, Suiza, Noruega, Islandia y Liechtenstein, probablemente debido a las exigencias del AI Act.

Esto nos recuerda que en regiones como América Latina, donde aún no existen marcos regulatorios sólidos, la brecha en gobernanza se amplía con cada innovación.

La verdadera pregunta no es si ChatGPT puede recordar. La pregunta es si puede olvidar. Y si ese olvido está bajo el control del usuario.

En un contexto donde cada vez más personas usan la IA para temas íntimos —como acompañamiento emocional o conversaciones tipo terapia—, lo que está en juego no es solo la experiencia de usuario, sino la confianza pública.

Y tú qué piensas?

Crees que esta memoria expandida mejora realmente la experiencia? O debería preocuparnos más lo que no se puede ver ni borrar completamente?

💬 Me encantará leer opiniones de especialistas en privacidad, machine learning y derecho digital.

Y si te interesa seguir estas discusiones, te invito a suscribirte a mi newsletter semanal: