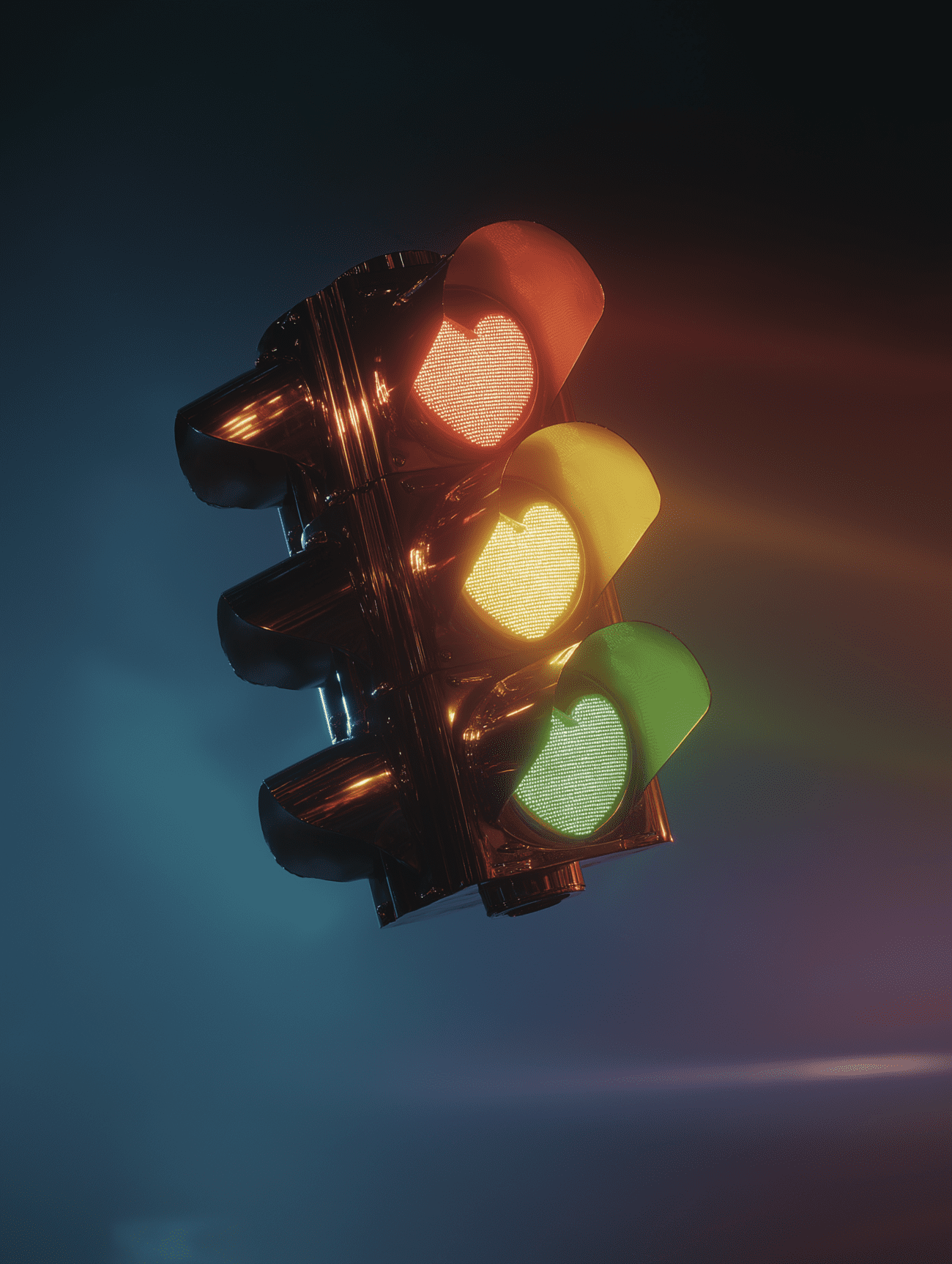

Hoy hablamos de: El indicador de riesgo que la mayoría de los equipos no está midiendo — y por qué operar sin él es exactamente lo mismo que operar en rojo sin saberlo.

Verde, amarillo o rojo: el costo de jurar que "estamos bien" con la IA

Un gerente revisaba cada KPI de su empresa. No había medido el riesgo humano de la IA. Tardó dos minutos en darse cuenta — y ese momento cambió cómo miraba su operación.

¿Qué es el riesgo humano en la adopción de IA y por qué es distinto al riesgo técnico o de ciberseguridad?

El riesgo humano en la adopción de IA es la probabilidad de que las personas que interactúan con sistemas de inteligencia artificial pierdan criterio, capacidad de supervisión o habilidades de juicio crítico como consecuencia del uso automatizado sostenido. A diferencia del riesgo técnico — que se refiere a fallos del sistema, vulnerabilidades de seguridad o errores de algoritmo — el riesgo humano opera de forma silenciosa y acumulativa: no produce una alerta inmediata, sino una degradación gradual de la calidad de las decisiones. Las políticas de ciberseguridad protegen la infraestructura tecnológica, no el proceso de pensamiento de quienes la usan.

Ejemplo práctico: Una empresa de servicios financieros implementó controles robustos de ciberseguridad en todos sus sistemas de IA. Sin embargo, cuando un auditor externo revisó el proceso de aprobación de créditos, encontró que los analistas aceptaban el 94% de las recomendaciones del modelo sin documentar ningún razonamiento propio. El riesgo técnico estaba gestionado. El riesgo humano no se había medido.

Fuente: Financial Stability Board — Financial Stability Implications of Artificial Intelligence, 2023

El gerente que revisaba todo menos su criterio

Esta semana, un gerente me dijo con total seguridad: "En mi empresa estamos bien, Karine. Ya tenemos políticas de ciberseguridad y la IA nos está ahorrando horas". Juraba estar en un verde impecable. No había ninguna duda en su voz, ninguna señal de alerta interna.

Le propuse que respondiera las cinco preguntas del Semáforo de Riesgo Humano. Su pantalla se puso amarilla en menos de dos minutos.

La tensión en su rostro fue inmediata. Él, que revisa cada KPI de la operación, no tenía respuesta para la mayoría de los puntos. Su equipo aprobaba respuestas sesgadas del chatbot de atención al cliente por no cuestionar a la máquina. Nadie en la empresa había definido quién tenía la autoridad — y la obligación — de pausar un proceso automatizado si algo olía mal.

Eso es lo que los indicadores de rendimiento habituales no capturan: la calidad del criterio humano detrás de las decisiones que la IA ejecuta o recomienda.

El verde imaginario y el síndrome del piloto automático

El error más caro en la adopción de IA para tu organización o tu vida cotidiana no es elegir la herramienta equivocada. Es asumir que conservas el criterio sin haberlo verificado. Ese es el riesgo humano no diagnosticado.

Con frecuencia, empezamos a operar con una falsa sensación de seguridad que deja desprotegido el proceso de pensamiento de las personas que toman las decisiones. No porque haya mala intención ni negligencia. Sino porque cuando la IA funciona rápido y suena convincente, la confianza crece de forma proporcional — y la supervisión decrece al mismo ritmo.

En el método S.E.N.S.E. llamamos a este patrón El Síndrome del Piloto Automático: delegamos decisiones aparentemente menores a la IA y dejamos de supervisarlas, no por descuido consciente, sino por una confianza mal ubicada. El algoritmo responde rápido y suena seguro, así que nadie quiere cuestionarlo.

El resultado de ese proceso acumulativo es el verde imaginario: ese estado mental donde todo parece bajo control solo porque todavía no ha ocurrido una catástrofe visible. El verde imaginario es cómodo. También es una de las condiciones de mayor riesgo real en una organización.

El primer síntoma de riesgo es el silencio

El insight más incómodo sobre el riesgo humano frente a la IA es este: el primer síntoma de riesgo real no es un error. Es el silencio.

El silencio de quien ya no verifica. El silencio de quien ya no pregunta "¿por qué?". El silencio de equipos que asumen que si la IA lo dijo, el resultado debe estar bien. Y el silencio de líderes que interpretan la ausencia de quejas como evidencia de que todo funciona.

Ese silencio se acelera por nuestra cultura de "resolver ya", donde compramos una falsa eficiencia que entrega resultados más rápido, pero con personas que entienden cada vez menos lo que están haciendo. La velocidad se convierte en la métrica central. El criterio, en un lujo que no hay tiempo de ejercer.

El costo de ignorar esa señal es operativo y acumulativo:

- Decisiones mal tomadas que nadie sabe revertir: cuando una decisión fue delegada completamente a la IA, la persona que la firmó a menudo no tiene el contexto necesario para corregirla si el resultado es incorrecto. La delegación elimina la comprensión.

- Talento que se fuga al sentir que su juicio ya no importa: los profesionales más capaces son los que más rápido detectan cuándo su criterio dejó de ser relevante. Son también los que primero buscan entornos donde sí lo sea.

- Degradación del clima que nadie supo nombrar: el "¿cómo no lo vimos venir?" que aparece después de una crisis no se arregla con más tecnología. Se arregla con gobernanza viva — y la gobernanza viva requiere haber medido el riesgo humano antes de que el daño fuera visible.

El verde se mide. Y si no tienes un termómetro para tu criterio, estás operando en un rojo estratégico sin saberlo.

El diagnóstico S.E.N.S.E. para saber en qué color estás

El método S.E.N.S.E. ofrece cinco preguntas concretas para hacer visible el riesgo humano que los indicadores habituales no capturan. Respóndelas con honestidad para saber en qué pilar está tu mayor vulnerabilidad esta semana:

S — Seguridad humana: ¿Qué error recurrente generado por IA está siendo aceptado en tu equipo "porque es más rápido" en lugar de ser corregido? Cuando la velocidad se convierte en criterio de validación, el error se normaliza antes de que nadie lo nombre.

E — Ética aplicada: ¿Qué decisión que requiere un juicio moral profundo — contrataciones, evaluaciones de desempeño, comunicaciones con impacto en personas — se está automatizando en tu organización sin supervisión humana explícita? La rapidez de un modelo no lo hace éticamente válido.

N — Neuroergonomía y bienestar: ¿Qué interrupciones constantes de herramientas de IA están fragmentando la atención de tu equipo y aumentando su fatiga mental? La fragmentación de la atención produce decisiones de menor calidad aunque la persona crea estar siendo eficiente.

S — Sentido y sociedad: ¿Quién tiene realmente el "botón de pausa" en tu flujo de trabajo, y bajo qué condiciones se atreve a usarlo? La existencia técnica de ese botón no basta: lo que importa es si la cultura organizacional da permiso real para activarlo.

E — Estrategia y autonomía: ¿Qué habilidad cognitiva esencial — la que representa tu ventaja real, la que ningún modelo puede replicar — se está perdiendo por la delegación automática? Esa pérdida es silenciosa. Cuando se detecta, a menudo ya lleva meses acumulándose.

En muchos equipos latinoamericanos, el primer pilar que cae a amarillo es Sentido y Criterio. El motivo es preciso: no falta ética. Faltan reglas de decisión explícitas. Quién decide. Cómo se valida. Cuándo se detiene. Esa ausencia de estructura es la diferencia entre un equipo que convive con la IA y un equipo que opera en verde imaginario.

El ejercicio de esta semana: ¿puedes revertirlo?

Antes de tu próxima reunión importante, o esta tarde si tienes un momento, haz este ejercicio:

Anota la última decisión o pieza de contenido que delegaste por completo a una IA — un correo redactado, un resumen ejecutivo, una recomendación de contratación, un análisis de datos. Cualquier output que salió a nombre tuyo o de tu equipo después de haber pasado por una herramienta de IA.

Ahora responde esta pregunta con honestidad: ¿Conservas el 100% del contexto necesario para revertir esa decisión si la máquina se equivocó?

Si la respuesta es un silencio, o un "no estoy seguro", o un "tendría que revisar", ya tienes una señal de alarma. No es una señal de que hiciste algo mal. Es una señal de que el indicador de riesgo humano en ese proceso está en amarillo — y que conviene saberlo antes de que se ponga rojo.

El criterio es tu ventaja real. La tecnología amplifica lo que ya tienes, y también amplifica lo que ya falta. Medirlo es el primer acto de protección.

Por qué la ciberseguridad no cubre este riesgo

Hay una confusión frecuente que vale la pena nombrar directamente: muchas organizaciones asumen que porque tienen políticas de ciberseguridad están protegidas frente a los riesgos de la IA. La ciberseguridad protege los sistemas. El riesgo humano frente a la IA es un riesgo de proceso cognitivo, de cultura organizacional y de criterio.

Puedes tener el servidor más seguro del mercado y al mismo tiempo tener un equipo que aprueba outputs sesgados porque nadie se siente con la autoridad de cuestionarlos. Esos dos riesgos viven en planos distintos. Los dos importan.

La gobernanza de la IA que protege de verdad a una organización trabaja en ambos niveles: en la seguridad técnica del sistema y en la salud del criterio de las personas que lo usan. Esa segunda dimensión es la que el método S.E.N.S.E. pone en el centro — porque es la que los dashboards de KPIs no muestran hasta que el daño ya está hecho.

Tu criterio es tu ventaja. Conócelo, mídelo y, sobre todo, protégelo.

¿Qué es el "verde imaginario" en gobernanza de IA y por qué es más peligroso que reconocer un riesgo real?

El "verde imaginario" es el estado de falsa seguridad que experimenta una organización o persona cuando asume que sus procesos con IA están bajo control en ausencia de evidencia que lo confirme. Se caracteriza por la ausencia de diagnóstico formal del riesgo humano y por la interpretación de la falta de incidentes visibles como prueba de que todo funciona bien. Es más peligroso que un riesgo reconocido porque impide la acción preventiva: una organización que sabe que tiene un riesgo amarillo puede actuar sobre él. Una organización en verde imaginario no siente urgencia de actuar hasta que el incidente ya se produjo.

Ejemplo práctico: Una empresa de logística implementó un sistema de IA para optimizar rutas de entrega y redujo sus costos operativos un 18% en el primer trimestre. El equipo directivo asumió que la transformación digital había sido un éxito. Ocho meses después, un auditor detectó que los conductores habían dejado de reportar anomalías en las rutas porque el sistema "siempre tenía razón" — lo que resultó en varios accidentes menores que no aparecían en los reportes de incidentes de la empresa.

¿Qué es el Síndrome del Piloto Automático en el uso de IA y cómo se instala en los equipos?

El Síndrome del Piloto Automático en el uso de IA es el patrón por el cual un equipo o individuo delega decisiones a sistemas automatizados de forma progresiva y deja de supervisarlas con el tiempo, no por negligencia deliberada sino porque la confianza en el sistema crece de forma proporcional a sus resultados visibles. El síndrome se instala gradualmente: primero se delegan tareas de bajo impacto, luego tareas de mayor complejidad, hasta que la supervisión humana se vuelve esporádica o desaparece. El criterio humano sigue existiendo formalmente pero deja de ejercerse en la práctica.

Ejemplo práctico: Un equipo de análisis financiero comenzó usando IA para generar resúmenes de reportes de mercado. Tras seis meses de resultados satisfactorios, empezó a incorporar recomendaciones del sistema directamente en presentaciones para clientes sin revisión independiente. Cuando el modelo produjo una recomendación basada en datos desactualizados en una presentación de alto perfil, ningún analista la detectó antes de la reunión porque el flujo de revisión humana había dejado de operar.

Fuente: Stanford HAI — AI Index Report 2024, Human-AI Interaction

¿Cómo afecta la cultura de "resolver ya" al criterio humano en entornos con alta adopción de IA?

La cultura de "resolver ya" — orientada a la velocidad de respuesta como métrica central de rendimiento — entra en conflicto directo con el ejercicio del criterio humano, que requiere tiempo, reflexión y tolerancia a la incertidumbre. En entornos con alta adopción de IA, esta cultura acelera el Síndrome del Piloto Automático: cuando la velocidad es el valor principal, la supervisión del output de la IA se percibe como una demora innecesaria. Las personas aprenden implícitamente que cuestionar el resultado de la herramienta es "ineficiente", y dejan de hacerlo aunque tengan dudas.

Ejemplo práctico: Un estudio publicado en el Journal of Applied Psychology analizó equipos de servicio al cliente con y sin presión de tiempo en sus métricas de rendimiento. En los equipos con alta presión de velocidad (tiempo de respuesta como KPI principal), la tasa de verificación del contenido generado por IA antes de enviarlo al cliente era un 67% menor que en los equipos donde la calidad de respuesta era la métrica principal, aunque ambos grupos usaban las mismas herramientas de IA.

¿Qué habilidades cognitivas se degradan con la delegación sistemática de decisiones a la IA?

La investigación en psicología cognitiva y neurociencia identifica tres habilidades que se degradan con mayor rapidez ante la delegación sistemática de decisiones a la IA: el pensamiento crítico aplicado (la capacidad de evaluar información en contexto y detectar inconsistencias), la memoria de trabajo de largo plazo relacionada con el dominio (el conocimiento operacional que permite detectar cuándo un resultado "no suena bien") y la tolerancia a la ambigüedad (la capacidad de tomar decisiones de calidad en condiciones de información incompleta). Estas tres habilidades son exactamente las que distinguen a un profesional experto de uno que ejecuta instrucciones.

Ejemplo práctico: Investigadores de la Universidad de Harvard realizaron un estudio longitudinal con consultores de estrategia que usaban herramientas de IA generativa. Tras doce meses, los consultores que usaban IA de forma autónoma sin protocolos de revisión mostraron una reducción del 23% en su capacidad para identificar supuestos erróneos en propuestas elaboradas por la IA, comparados con el grupo de control que mantenía revisión independiente. La capacidad de detección de errores se atrofiaba con el desuso.

¿Qué es un Semáforo de Riesgo Humano en IA y para qué sirve en una organización?

Un Semáforo de Riesgo Humano en IA es un instrumento de diagnóstico que evalúa el estado del criterio, la supervisión y la autonomía de las personas y equipos que interactúan con sistemas de inteligencia artificial. A diferencia de las auditorías técnicas de IA, que evalúan el rendimiento del modelo, el Semáforo evalúa el rendimiento del juicio humano en el contexto de uso de la IA. Sus resultados se expresan en tres niveles: verde (criterio activo, supervisión presente, riesgo gestionado), amarillo (señales de alerta que requieren ajuste de protocolos) y rojo (degradación del criterio que requiere intervención inmediata). Su propósito es hacer visible un riesgo que los indicadores de rendimiento habituales no capturan.

Ejemplo práctico: Una empresa de medios de comunicación aplicó el Semáforo de Riesgo Humano a su equipo editorial tras implementar IA generativa para la producción de contenido. Cuatro de sus cinco redactores resultaron en amarillo por el pilar de Sentido y Criterio: ninguno tenía claro quién tenía la responsabilidad final sobre los artículos generados con apoyo de IA ni cuándo ese output requería revisión editorial completa. El diagnóstico generó un protocolo en dos semanas que no existía antes.

Fuente: OECD AI Principles — Human Oversight and Accountability, 2023

Tu siguiente paso después del diagnóstico

El Semáforo de Riesgo Humano te da el color. Los kits te dan el protocolo. Si saliste en amarillo o rojo y tu mayor contexto es tu vida personal y tu familia, el Kit Criterio en Familia te da las acciones concretas para recuperar la calma y el criterio en 48 horas — sin tecnicismos y sin reuniones.

Si tu foco es tu equipo o empresa, el Kit Liderazgo Consciente mapea los riesgos operativos y humanos con un roadmap claro — para que sepas qué automatizar, qué supervisar siempre y qué nunca delegar. Treinta páginas prácticas que van directo al punto de mayor vulnerabilidad de tu equipo.