Hoy hablamos de: Por qué la perfección paraliza la gobernanza de IA — y cómo tres reglas concretas escritas en una pizarra pueden devolver la calma a un equipo en menos de 48 horas.

48 horas para bajar tu riesgo humano frente a la IA: de la parálisis a la acción

Una startup con cero reglas de uso de IA, dos clientes afectados y un fundador agobiado. Lo que ocurrió en 48 horas — y qué puedes aplicar tú antes del cierre de esta semana.

¿Qué es la parálisis por análisis en gobernanza de IA y por qué deja a los equipos sin protección?

La parálisis por análisis en gobernanza de IA es el fenómeno por el cual una organización pospone indefinidamente la implementación de criterios y protocolos de uso de inteligencia artificial porque espera tener una solución completa, perfecta o validada externamente antes de actuar. El resultado práctico es que el equipo continúa usando herramientas de IA sin ningún marco de referencia mientras los responsables debaten qué política elaborar. La brecha entre el uso real y la gobernanza disponible crece cada semana de inacción.

Ejemplo práctico: Una firma de consultoría latinoamericana con 40 empleados llevaba ocho meses intentando redactar una política de ética de IA "completa". Durante ese tiempo, los consultores usaron herramientas generativas para elaborar informes para clientes sin ningún criterio compartido sobre qué revisar, qué datos podían procesarse y qué outputs debían ser validados por un humano. El primer incidente con un cliente llegó antes de que la política estuviera lista.

Fuente: OECD — AI Governance in Firms: Key Findings and Recommendations, 2024

La startup sin una sola regla sobre la mesa

La semana pasada me escribió el fundador de una startup. El mensaje llegó en tono de urgencia — de esa urgencia que mezcla el cansancio con la incomodidad de saber que algo se salió de control.

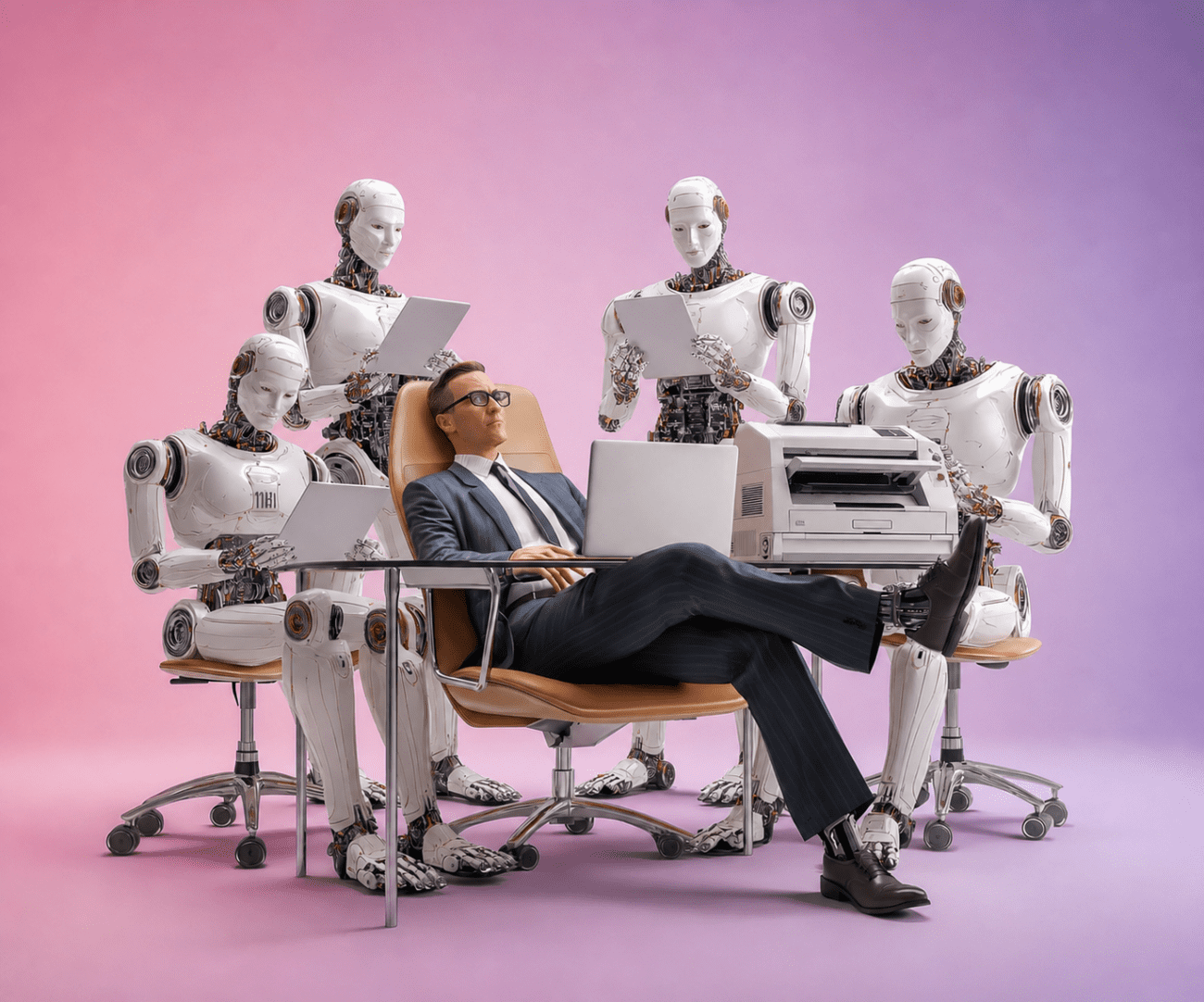

Su equipo de doce personas usaba IA para casi todo: redactar respuestas a clientes, resumir reuniones internas, revisar primeros borradores de código. Nada de eso es necesariamente un problema. Lo que sí era un problema es que nadie había puesto una sola regla sobre la mesa. Cada persona del equipo tomaba sus propias decisiones sobre qué delegar a la IA, sin un criterio compartido, sin saber qué debía revisarse siempre, qué datos podían o no procesarse, o qué outputs merecían una segunda mirada humana.

El resultado fue predecible: ansiedad digital en el equipo — esa sensación crónica de que algo puede fallar pero nadie sabe exactamente qué ni cuándo. Respuestas a clientes con tonos inconsistentes. Y dos clientes que recibieron información errónea en un mismo mes porque "la IA alucinó" y nadie revisó el output antes de enviarlo.

Me preguntó si necesitaban un comité de ética de seis meses. Le dije que no. Lo que su equipo necesitaba era hacer tres preguntas en una reunión de treinta minutos y escribir las respuestas en una pizarra.

El costo real de esperar a tenerlo todo perfecto

La mayoría de las organizaciones que se enfrentan al problema de la gobernanza de IA cometen el mismo error: creen que la única solución válida es una solución completa. Política de cincuenta páginas. Auditoría externa. Comité formal. Reunión mensual de seguimiento.

Mientras tanto, el equipo ya usa herramientas sin supervisión. Cada semana que pasa sin un criterio mínimo es una semana de riesgo acumulado: riesgo reputacional, riesgo de calidad, riesgo de confianza interna.

En el método S.E.N.S.E. llamamos a este patrón Parálisis por el Análisis en ética digital: la creencia de que si la solución no es perfecta, es mejor no moverse. Es una trampa de perfeccionismo que se disfraza de responsabilidad.

El costo de no actuar hoy es medible y concreto:

- Crisis de reputación: un cliente que recibe información incorrecta generada por IA sin revisión humana pierde confianza en el criterio de la organización, aunque la tecnología sea la que falló técnicamente.

- Equipos que dudan: sin un marco mínimo, cada persona del equipo gasta energía cognitiva decidiendo si es correcto usar IA para cada tarea. Esa energía se substrae de la calidad del trabajo y acumula fatiga.

- Talento que se fatiga: los profesionales más cuidadosos del equipo — los que sí se preguntan si están haciendo las cosas bien — son los que más sufren la ausencia de criterio compartido. Son también los que primero se van.

- Decisiones sin dueño: cuando no hay criterio compartido, nadie se siente responsable de los outputs de la IA. La responsabilidad se diluye hasta que el daño ya está hecho.

La gobernanza viva no se soluciona con disculpas públicas después de un incidente. Se construye antes.

48 horas, 3 reglas, una pizarra

Esto fue lo que hizo la startup. En una reunión de equipo de treinta minutos respondieron tres preguntas y escribieron las respuestas donde todos pudieran verlas:

¿Qué tareas de IA requieren siempre una revisión humana antes de salir? Toda comunicación directa con clientes. Todo contenido que lleve el nombre de alguien del equipo. Toda decisión que afecte el presupuesto o los plazos de un proyecto.

¿Qué datos del negocio o de los clientes no deben procesarse en herramientas externas de IA? Información de contratos. Datos financieros del cliente. Cualquier información que los clientes compartieron con expectativa de confidencialidad.

¿Quién tiene la última palabra cuando alguien duda si usar IA para algo? El responsable de la cuenta o del proyecto. Si no está disponible, la respuesta por defecto es: no usarlo.

Tres frases. Una pizarra. Cuarenta y ocho horas después, el equipo tenía un criterio compartido. La ansiedad digital empezó a bajar. Las respuestas a clientes se volvieron más consistentes porque ahora había un proceso, aunque fuera mínimo.

El antídoto cabe en una hoja porque la gobernanza de IA eficaz empieza siempre desde lo más pequeño que puede funcionar hoy — lo que en el método S.E.N.S.E. llamamos protocolos tácticos de intervención mínima.

El diagnóstico S.E.N.S.E. para saber por dónde empezar

Si estás en un equipo que usa IA sin un marco claro — o si simplemente tienes la sensación de que algo falta pero no sabes qué — el método S.E.N.S.E. ofrece cinco preguntas para ubicar tu punto de mayor vulnerabilidad esta semana:

S — Seguridad humana: ¿Qué política de uso de IA prometiste implementar y lleva más de un mes en tu lista de pendientes? La respuesta honesta a esta pregunta suele revelar el primer punto de acción.

E — Ética aplicada: ¿Qué tipo de decisión — contenido, evaluación de personas, respuesta a clientes — está tomando tu equipo sin un criterio compartido porque "no hay tiempo de ponerse de acuerdo"? Esa decisión es exactamente la que necesita un criterio mínimo antes de la próxima vez que ocurra.

N — Neuroergonomía: ¿Cuántas veces tu equipo tuvo que "adivinar" si era correcto usar IA para una tarea hoy? Cada adivinanza es energía cognitiva mal invertida. El objetivo del criterio compartido es eliminar esa fricción, que el camino correcto sea el más fácil de seguir.

S — Sentido y sociedad: ¿Quién definió las reglas actuales de uso de IA en tu equipo, o cada persona decide por su cuenta? Si la respuesta es la segunda, tu equipo no tiene gobernanza: tiene informalidad acumulada.

E — Estrategia y autonomía: ¿Qué parte de tu operación diaria depende de que cada persona "use su criterio" sin un marco mínimo que lo respalde? La autonomía sin criterio compartido no es libertad: es exposición sin red.

Una micro-acción según tu pilar más débil

El diagnóstico S.E.N.S.E. no sirve solo para saber cómo estás. Sirve para saber qué hacer primero. Cada pilar tiene una micro-acción correspondiente que puedes completar hoy, antes del cierre de tu jornada:

- Si tu pilar más débil fue Seguridad: escribe las tres tareas que en tu equipo nunca deben hacerse con IA sin revisión humana. Tres líneas. Compártelas con quien corresponda antes del final del día.

- Si fue Ética: define hoy qué decisión recurrente de tu equipo requiere siempre una firma o validación humana antes de ejecutarse. Una sola decisión. Una sola regla.

- Si fue Neuroergonomía: acuerda con tu equipo no usar IA en los últimos treinta minutos antes de cerrar el día. Un descanso de criterio intencional, en lugar de la fatiga de decidir hasta el final.

- Si fue Sentido: añade una pregunta a la reunión de mañana: "¿Cuándo fue la última vez que alguien en este equipo cuestionó a la IA y lo celebramos?" La respuesta te dirá si la cultura ya permite disentir o si aún tiene miedo de hacerlo.

- Si fue Estrategia: anota una tarea que siempre harás tú, sin IA, porque ahí está el valor que ningún modelo puede replicar. Ese reconocimiento es el primer paso para protegerlo.

La calma regresa cuando el caos tiene un procedimiento. Y un procedimiento puede ser tan pequeño como tres líneas en una pizarra.

Por qué las micro-reglas funcionan donde los grandes marcos fallan

Hay una razón por la que las políticas extensas de ética de IA suelen quedarse en cajones y las micro-reglas sí se aplican. Las políticas requieren que las personas las lean, las recuerden y las interpreten en tiempo real. Las micro-reglas eliminan la interpretación: son respuestas predefinidas a situaciones predecibles.

La diferencia cognitiva es enorme. Una persona que trabaja bajo presión con un deadline en dos horas no va a abrir un documento de cincuenta páginas para decidir si puede usar IA para redactar un correo. Una persona que tiene claro que "toda comunicación directa con clientes se revisa antes de enviarse" no necesita pensar: ya sabe qué hacer.

En el método S.E.N.S.E., el principio detrás de esto se llama diseño de entorno protector: configurar el contexto de trabajo para que la decisión correcta sea la más fácil, antes de que llegue la presión. No es disciplina. Es diseño.

Eso es lo que hizo la startup en 48 horas. Y eso es lo que puedes hacer tú antes del cierre de esta semana.

¿Qué son las micro-reglas de gobernanza de IA y cómo se diferencian de una política formal?

Las micro-reglas de gobernanza de IA son criterios concretos, breves y aplicables de forma inmediata que un equipo define para orientar el uso de herramientas de inteligencia artificial en situaciones cotidianas. Se diferencian de una política formal en tres aspectos: son memorables (pueden recordarse sin leer un documento), son accionables (indican exactamente qué hacer en una situación específica) y son implementables en horas, sin procesos de aprobación complejos. Su objetivo es cerrar la brecha entre el uso real de la IA y la ausencia de criterios, mientras se desarrolla una gobernanza más robusta.

Ejemplo práctico: Un equipo de marketing de una PYME implementó tres micro-reglas en una tarde: "Todo contenido que lleve el nombre de un cliente se revisa antes de publicar", "Los datos de campañas activas no se procesan en herramientas de IA gratuitas" y "Quien dude si una tarea es apropiada para IA consulta antes de proceder". En tres semanas, los incidentes relacionados con outputs de IA sin revisar bajaron de cuatro por mes a cero.

¿Qué es la ansiedad digital en equipos que usan IA sin protocolos y cómo afecta el rendimiento?

La ansiedad digital en equipos con IA es el estado crónico de incertidumbre que experimenta un profesional cuando utiliza herramientas de inteligencia artificial para tareas con impacto real sin saber si está haciéndolo correctamente, si el resultado es confiable o si podría haber consecuencias que no prevé. Esta ansiedad se amplifica en ausencia de criterios compartidos: cada persona del equipo debe resolver individualmente preguntas que deberían estar respondidas a nivel organizacional, lo que consume energía cognitiva y genera inconsistencias en los outputs.

Ejemplo práctico: Una encuesta realizada por el MIT Sloan Management Review en 2023 encontró que el 58% de los trabajadores del conocimiento que usaban herramientas de IA generativa reportaban sentir "incertidumbre frecuente" sobre si su uso era apropiado en el contexto de trabajo. En equipos con políticas documentadas de uso de IA, ese porcentaje bajaba al 21%.

Fuente: MIT Sloan Management Review — The Human Side of Generative AI at Work, 2023

¿Por qué las políticas extensas de ética de IA fallan en organizaciones pequeñas y medianas?

Las políticas extensas de ética de IA fracasan en organizaciones pequeñas y medianas por tres razones principales. Primero, el costo de elaboración supera los recursos disponibles: requieren tiempo de personas que ya tienen plena carga operativa. Segundo, el tiempo entre el inicio del uso de la IA y la finalización de la política es tan largo que el equipo ya estableció hábitos informales que la política llega demasiado tarde para corregir. Tercero, los documentos extensos no se leen ni se recuerdan bajo presión: no están diseñados para ser aplicados en tiempo real. El resultado es una política que existe formalmente pero no modifica conductas.

Ejemplo práctico: La Comisión Europea documentó en su estudio sobre adopción de IA en PYMEs que solo el 12% de las empresas de menos de 250 empleados con una política de uso de IA publicada podía demostrar que esa política se aplicaba de forma consistente en decisiones cotidianas. El 88% restante tenía documentos, no gobernanza.

Fuente: European Commission — SME Strategy for a Sustainable and Digital Europe, 2024

¿Qué significa "diseñar el entorno protector" en gobernanza de IA para equipos?

Diseñar el entorno protector en gobernanza de IA significa configurar el contexto de trabajo para que la decisión correcta frente a la IA sea la más fácil de tomar, antes de que llegue la presión de una tarea urgente. En lugar de depender de que cada persona recuerde y aplique una política bajo carga cognitiva, el entorno protector convierte el criterio correcto en el camino de menor resistencia: listas de verificación visibles, acuerdos de equipo explícitos, puntos de revisión obligatoria antes de que un output salga del equipo. Este principio proviene del diseño conductual y ha sido aplicado al diseño de sistemas de gobernanza tecnológica por investigadores de gobernanza responsable.

Ejemplo práctico: Un equipo de atención al cliente añadió un campo obligatorio en su herramienta de gestión de tickets: "¿Este texto fue generado por IA? Sí / No". Si la respuesta era sí, el sistema no permitía enviar la respuesta sin que un supervisor lo marcara como revisado. El cambio redujo los errores en comunicaciones a clientes en un 76% en el primer mes sin necesidad de formación adicional.

Fuente: Behavioural Insights Team — Applying Behavioural Insights to Digital Design, 2022

¿Cuál es el costo humano de la falta de gobernanza de IA en startups y equipos de trabajo?

El costo humano de operar sin gobernanza de IA en startups y equipos de trabajo se distribuye en tres dimensiones. A nivel individual, produce fatiga de decisión: las personas gastan energía cognitiva resolviendo preguntas que no deberían ser individuales, lo que reduce la calidad de su trabajo y su bienestar. A nivel de equipo, genera inconsistencia en los outputs y pérdida de confianza interna cuando se producen errores difíciles de atribuir. A nivel organizacional, daña la relación con clientes y stakeholders cuando los fallos llegan al exterior — y en ese punto, el costo de reparación siempre supera el costo de prevención.

Ejemplo práctico: Un estudio de Deloitte sobre impacto de IA generativa en el trabajo publicado en 2024 encontró que los equipos sin protocolos documentados de uso de IA reportaban niveles de agotamiento cognitivo un 34% más altos que los equipos con criterios mínimos establecidos, incluso cuando ambos grupos tenían la misma carga de trabajo. La diferencia no estaba en cuánto trabajaban, sino en cuánto debían decidir solos.

Fuente: Deloitte Insights — AI and the Future of Human Work, 2024

Herramientas para recuperar tu criterio cuando la IA ya está en tu equipo

Si el diagnóstico S.E.N.S.E. te dio amarillo o rojo y tu mayor preocupación es tu dinámica personal con la IA — tu criterio propio, tus decisiones, tu pensamiento — el Kit Pensamiento Propio es el punto de partida. Son 30 páginas prácticas para recuperar la autoría de tus elecciones cuando el automatismo ya instaló sus propias reglas. Con método. Con calma. Sin drama técnico.

Si tu contexto es familiar — y tu preocupación son tus hijos, la dinámica en casa o los límites digitales en el hogar — el Kit Criterio en Familia ofrece un protocolo de acción inmediata para ese entorno.

Y si lo que reconociste está en tu equipo o empresa, el Kit Liderazgo Consciente mapea los riesgos operativos y humanos con un roadmap claro — para que sepas qué automatizar, qué supervisar y qué nunca delegar.