Hoy Hablamos Sobre

IA ética, responsable, confiable y gobernada: ¿son lo mismo?

Descubre la diferencia

El Arte Perdido de la Comunicación con IA

IA ética, responsable, confiable y gobernada: ¿son lo mismo?

En los últimos años, conceptos como IA ética, IA responsable, IA confiable y gobernanza de la IA se han vuelto comunes en discursos corporativos, políticas públicas y debates académicos. Sin embargo, aún hoy muchas organizaciones los utilizan como sinónimos, generando confusión y dejando vacíos estratégicos en sus programas de gestión de riesgos.

En este artículo, desglosamos de forma clara y práctica qué significa cada uno, cómo se relacionan y por qué distinguirlos es clave para liderar la transformación digital de forma segura, justa y alineada con la sociedad.

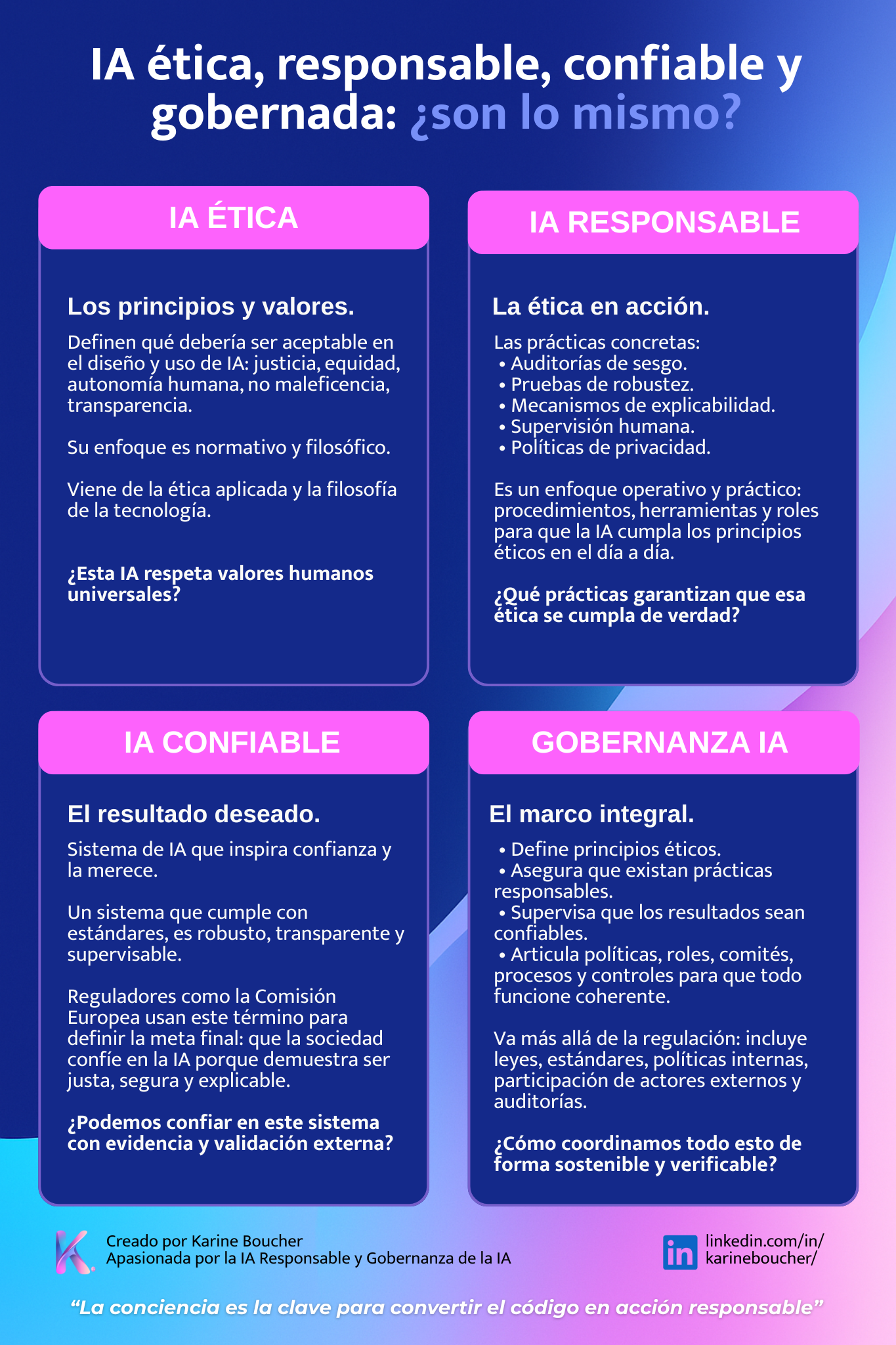

1️⃣ IA Ética: los principios y valores (Ethical AI)

Cuando hablamos de IA Ética nos referimos a los principios y valores que deberían guiar todo el ciclo de vida de un sistema de IA: desde su diseño hasta su uso y desmantelamiento. Conceptos como la equidad, la justicia, la no discriminación, la autonomía humana, la transparencia y la dignidad son parte de esta base ética.

Su enfoque es principalmente normativo y filosófico: establece el “qué debería ser”. La IA Ética responde a la pregunta: ¿está este sistema alineado con los valores fundamentales de la sociedad?

2️⃣ IA Responsable: la ética en acción (Responsible AI)

Para que una IA sea realmente ética, necesita mecanismos que garanticen su cumplimiento en la práctica. Ahí surge la IA Responsable.

La IA Responsable traduce principios en procesos concretos: auditorías de sesgo, pruebas de robustez, técnicas de explicabilidad, supervisión humana, políticas de privacidad y seguridad. Es la dimensión operativa: “cómo hacemos que la ética se cumpla todos los días”.

Este enfoque está cada vez más impulsado por marcos regulatorios, estándares técnicos y buenas prácticas industriales.

3️⃣ IA Confiable: el resultado visible (Trustworthy AI)

Un sistema ético, construido de forma responsable, genera como resultado una IA Confiable. Este término —promovido especialmente por la Comisión Europea— destaca la importancia de que la IA no solo funcione bien internamente, sino que además inspire confianza y merezca ser confiable ante la sociedad, clientes y reguladores.

La IA Confiable se evalúa por su robustez, explicabilidad, seguridad y la claridad en la rendición de cuentas. También puede validarse mediante auditorías externas y certificaciones, aumentando la credibilidad y la adopción.

4️⃣ Gobernanza de la IA: el marco que orchestra (AI Governance)

Ahora bien, tener principios, prácticas y resultados confiables no es automático. Requiere un marco de Gobernanza de la IA que articule políticas internas, roles, comités, estándares técnicos y regulaciones externas.

La gobernanza funciona como un “sistema nervioso” que conecta ética, responsabilidad y confianza en un ciclo continuo de control y mejora. Organismos como la NIST, la UE con su AI Act, la UNESCO y la OCDE destacan que la gobernanza va más allá de la simple regulación: incluye principios voluntarios, estándares industriales y participación de todos los actores, desde técnicos hasta usuarios y sociedad civil.

¿Cómo se relacionan estos conceptos?

Una forma clara de entenderlos es visualizarlo como una arquitectura:

- IA Ética: define el qué — los principios y valores.

- IA Responsable: establece el cómo — prácticas y procesos que implementan esos principios.

- IA Confiable: es el resultado — un sistema digno de confianza.

- Gobernanza de la IA: es el marco — que conecta, supervisa y refuerza todo lo anterior.

¿Por qué es importante diferenciar estos términos?

Porque hablar de ética sin prácticas es solo un buen deseo.

Hablar de responsabilidad sin gobernanza es inviable.

Y esperar confianza sin ética, prácticas ni supervisión… es ingenuo.

Mejor ilustremos con el ejemplo de un vehículo autónomo

Imagina un coche autónomo. Los principios de IA Ética determinan que el coche debe priorizar la seguridad humana y minimizar daños. La IA Responsable asegura que se utilicen datos representativos, se realicen pruebas exhaustivas y se permita la supervisión humana. El coche será confiable si, en la práctica, muestra robustez, explicabilidad y seguridad validada. Y todo esto se hace realidad dentro de un marco de gobernanza que define políticas, estándares, auditorías y roles claros para responder ante incidentes.

En la era de la IA, diferenciar estos conceptos no es opcional. Es la base para tomar decisiones estratégicas, cumplir con regulaciones y generar confianza dentro y fuera de tu organización.

Quieres aprender más sobre la IA Responsable y Gobernanza de la IA, mira los artículos de blog que he redactado para ti.

Para cualquier duda que puedas tener, me puedes mandarme email a info@karine.ai, con mucho gusto te contestaré.